En trafiquant la démo de Gemini, Google s’est tiré une balle dans le pied

24 heures après l’annonce du modèle de langage multimodal Gemini, les coulisses de la vidéo de démonstration publiée par Google commencent à être révélées. Google a enregistré de fausses questions, pour donner l’impression que Gemini devinait le contexte. En réalité, les questions posées par Google aiguillaient l’IA vers les bonnes réponses.

Google a-t-il menti sur l’intelligence de Gemini, son nouveau modèle de langage présenté comme supérieur au GPT-4 d’OpenAI ? Si rien ne permet aujourd’hui de remettre en question les affirmations du géant du web, force est de constater que Google a commis une erreur dans sa manière de présenter les choses.

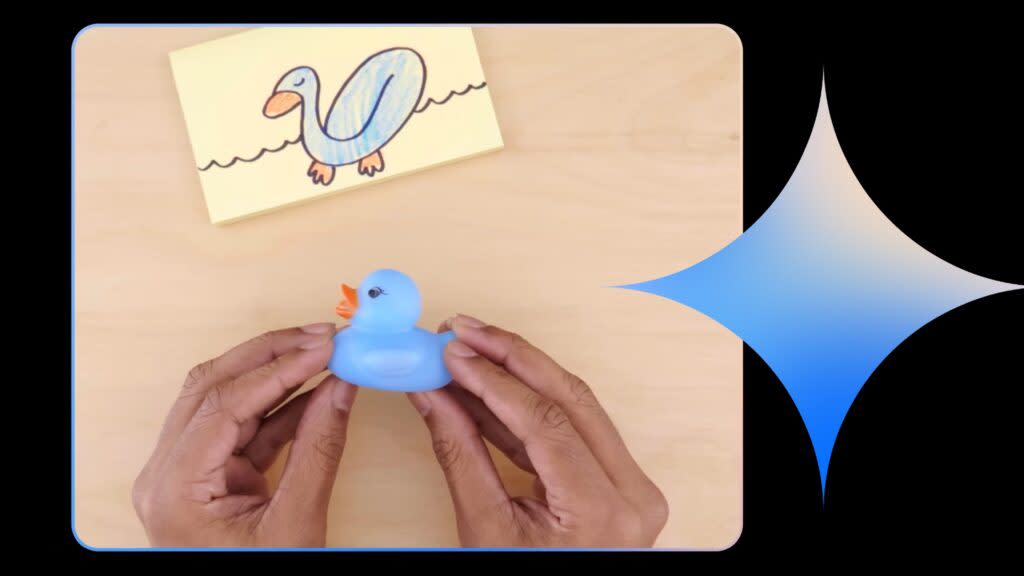

Dans une vidéo de 6 minutes et 23 secondes, diffusée le 6 décembre 2023 et massivement partagée dans les médias et sur les réseaux sociaux, Google présentait Gemini comme une super-IA façon Jarvis (Iron Man), avec d’incroyables capacités de compréhension de ce qui l’entoure. Gemini semblait capable de voir le monde en temps réel et de le commenter, avec une logique digne d’un être humain. Son interlocuteur se contentait de petites relances orales à chaque fois, qui paraissaient suffisantes pour que l’IA devine ce qu’on lui demande et fournisse des réponses complètes. En réalité, Gemini ne se comportera probablement jamais ainsi.

Comme l’ont remarqué plusieurs internautes, le site de Google indique que plusieurs éléments ont été changés dans la vidéo de démonstration, qui fait passer Gemini pour ce qu’il n’est pas.

Crédits photos de l'image de une : Gemini // Source : Google

Yahoo Actualités

Yahoo Actualités